Proaktive KI-Risikominimierung für sichere AI-Adoption

Gefahren durch KI

KI birgt erhebliche Gefahren: von Adversarial Attacks und Data Poisoning über KI-Halluzinationen bis zu Datenschutzverstößen und EU AI Act-Risiken. ADVISORI identifiziert, bewertet und minimiert KI-Gefahren mit einem Safety-First-Ansatz – für regulatorisch sichere und verantwortungsvolle KI-Implementierung.

- ✓Umfassende KI-Risikoanalyse und Bedrohungsmodellierung

- ✓Schutz vor Adversarial Attacks und Model Poisoning

- ✓DSGVO-konforme AI Security und Datenschutzmaßnahmen

- ✓Proaktive Governance für sichere KI-Systeme

Ihr Erfolg beginnt hier

Bereit für den nächsten Schritt?

Schnell, einfach und absolut unverbindlich.

Zur optimalen Vorbereitung:

- Ihr Anliegen

- Wunsch-Ergebnis

- Bisherige Schritte

Oder kontaktieren Sie uns direkt:

Zertifikate, Partner und mehr...

KI Gefahren verstehen, bewerten und minimieren

Unsere Expertise

- Spezialisierte Expertise in KI-Sicherheit und Threat Modeling

- Umfassende Erfahrung mit Adversarial ML und Robustness Testing

- DSGVO-konforme AI Security Frameworks

- Proaktive Incident Response und Continuous Monitoring

⚠

Sicherheitshinweis

KI-Systeme sind nur so sicher wie ihre schwächste Komponente. Eine proaktive Sicherheitsstrategie, die alle Aspekte von Datenqualität über Modellrobustheit bis hin zu Deployment-Sicherheit abdeckt, ist essentiell für den sicheren Einsatz von Künstlicher Intelligenz.

ADVISORI in Zahlen

11+

Jahre Erfahrung

120+

Mitarbeiter

520+

Projekte

Wir verfolgen einen systematischen, risikobasierten Ansatz zur Identifikation und Minimierung von KI-Gefahren, der technische Sicherheitsmaßnahmen mit organisatorischen Governance-Strukturen kombiniert.

Unser Ansatz

1

Phase 1

Umfassende KI-Risikoanalyse und Bedrohungsmodellierung

2

Phase 2

Implementierung mehrschichtiger Sicherheitsarchitekturen

3

Phase 3

Entwicklung spezifischer Schutzmaßnahmen gegen identifizierte Bedrohungen

4

Phase 4

Etablierung kontinuierlicher Überwachungs- und Response-Prozesse

5

Phase 5

Regelmäßige Sicherheitsbewertungen und Anpassungen

"KI-Sicherheit ist nicht nur eine technische Herausforderung, sondern ein strategischer Imperativ für jedes Unternehmen, das Künstliche Intelligenz einsetzen möchte. Unser proaktiver Ansatz zur Identifikation und Minimierung von KI-Gefahren ermöglicht es unseren Kunden, die Vorteile der AI-Technologie zu nutzen, ohne dabei unkalkulierbare Risiken einzugehen. Sicherheit und Innovation müssen Hand in Hand gehen."

Asan Stefanski

Head of Digital Transformation

Expertise & Erfahrung:

11+ Jahre Erfahrung, Studium Angewandte Informatik, Strategische Planung und Leitung von KI-Projekten, Cyber Security, Secure Software Development, AI

Unsere Dienstleistungen

Wir bieten Ihnen maßgeschneiderte Lösungen für Ihre digitale Transformation

KI-Risikoanalyse und Threat Assessment

Systematische Identifikation und Bewertung aller potentiellen Bedrohungen für Ihre KI-Systeme.

- Umfassende Bedrohungsmodellierung für KI-Systeme

- Analyse von Angriffsvektoren und Schwachstellen

- Risikobewertung und Priorisierung von Schutzmaßnahmen

- Entwicklung spezifischer Sicherheitsanforderungen

Adversarial Attack Prevention

Schutz vor gezielten Angriffen auf KI-Modelle durch robuste Sicherheitsarchitekturen.

- Implementierung adversarial robuster Modelle

- Input Validation und Anomalie-Erkennung

- Defensive Distillation und Model Hardening

- Kontinuierliche Robustness Testing

Data Poisoning Protection

Sicherung der Datenintegrität und Schutz vor manipulierten Trainingsdaten.

- Datenvalidierung und Integritätsprüfungen

- Anomalie-Erkennung in Trainingsdaten

- Sichere Datenquellen und Provenance Tracking

- Robust Training Techniques

AI Privacy und DSGVO Compliance

Gewährleistung des Datenschutzes und der DSGVO-Konformität in KI-Systemen.

- Privacy-by-Design für KI-Architekturen

- Differential Privacy Implementierung

- Federated Learning für Datenschutz

- DSGVO-konforme Datenverarbeitung

AI Security Governance

Etablierung umfassender Governance-Strukturen für sichere KI-Entwicklung und -Betrieb.

- Entwicklung von AI Security Policies

- Sicherheitsrichtlinien für ML-Pipelines

- Incident Response Procedures

- Security Awareness Training

Continuous AI Security Monitoring

Kontinuierliche Überwachung und Bewertung der Sicherheit Ihrer KI-Systeme.

- Real-time Security Monitoring

- Automated Threat Detection

- Performance und Security Metrics

- Regelmäßige Security Assessments

Unsere Kompetenzen im Bereich KI - Künstliche Intelligenz

Wählen Sie den passenden Bereich für Ihre Anforderungen

AI Governance Beratung

Ihre Mitarbeiter nutzen bereits KI. Im Marketing schreibt ChatGPT Texte mit Kundendaten. Im Vertrieb analysiert Copilot vertrauliche Angebote. In der Buchhaltung prüft eine KI Rechnungen. Die Geschäftsführung? Weiß in den meisten Fällen nichts davon. Kein Überblick, keine Regeln, keine Kontrolle. Das ist der Normalzustand in deutschen Unternehmen — und es ist eine tickende Zeitbombe.

Absicherung von KI-Systemen

Schützen Sie Ihre KI-Systeme mit maßgeschneiderten Sicherheitsmaßnahmen. ADVISORI sichert Ihre AI-Infrastruktur gegen Adversarial Attacks, Data Poisoning und Model Extraction – EU AI Act-konform und DSGVO-ready.

Adversarial KI Attacks

Schützen Sie Ihre KI-Modelle vor Adversarial Attacks mit spezialisierten Abwehrstrategien. ADVISORI analysiert Ihre KI-Systeme auf adversarielle Schwachstellen und implementiert robuste Schutzmaßnahmen – EU AI Act-konform und DSGVO-ready.

Aufbau interner KI-Kompetenzen

Bauen Sie KI-Kompetenzen systematisch auf - von der Fuehrungsebene bis zu operativen Teams. ADVISORI entwickelt Ihre KI-Schulungsstrategie, ein KI Center of Excellence und EU AI Act-konforme Talentprogramme für nachhaltige Wettbewerbsvorteile.

Azure OpenAI Sicherheit

Nutzen Sie die Kraft von Azure OpenAI mit unserem Safety-First-Ansatz. Wir implementieren sichere, DSGVO-konforme Cloud-AI-Lösungen, die Ihr geistiges Eigentum schützen und gleichzeitig die volle Innovationskraft von Microsoft Azure OpenAI erschließen.

Beratung KI-Sicherheit

Schuetzen Sie Ihr Unternehmen vor KI-spezifischen Risiken mit professioneller KI-Sicherheitsberatung. ADVISORI entwickelt EU AI Act-konforme Security Frameworks, schuetzt vor Adversarial Attacks und Data Poisoning und sichert Ihre KI-Systeme DSGVO-konform.

DSGVO für KI

Implementieren Sie Künstliche Intelligenz rechtskonform und datenschutzfreundlich. Unsere Experten unterstützen Sie bei der DSGVO-konformen Gestaltung von AI-Systemen, von der Konzeption bis zur Umsetzung.

DSGVO-konforme KI-Lösungen

Künstliche Intelligenz unter vollständiger DSGVO-Compliance: Privacy-by-Design-Implementierung, automatisierte Entscheidungsfindung nach Art. 22 DSGVO, Datenschutz-Folgenabschätzung (DSFA) für KI-Systeme und Vorbereitung auf den EU AI Act. ADVISORI macht Ihre KI rechtskonform, erklärbar und auditbereit.

Data Poisoning KI

Data Poisoning Angriffe vergiften KI-Modelle durch manipulierte Trainingsdaten – oft unbemerkt bis zum Produktiveinsatz. ADVISORI erkennt und neutralisiert diese Bedrohungen mit forensischer Datenanalyse, Anomalie-Erkennung und Safety-by-Design-Architekturen. Schützen Sie Ihre KI-Investitionen und erfüllen Sie die Sicherheitsanforderungen des EU AI Act.

Datenintegration für KI

Ohne hochwertige, integrierte Daten kein leistungsstarkes KI-Modell. ADVISORI entwickelt DSGVO-konforme Datenpipelines und Enterprise Data Architectures, die Ihre Rohdaten in auditierbare, KI-gerechte Datensaetze verwandeln. Von der Datenquelle bis zum trainierten Modell - sicher, skalierbar und compliant.

Datenlecks durch LLMs verhindern

Schützen Sie Ihr Unternehmen vor Datenlecks durch Large Language Models. Unsere Safety-First-Methodik gewährleistet DSGVO-konforme LLM-Implementierungen mit umfassendem Schutz Ihres geistigen Eigentums und sensibler Unternehmensdaten.

Datenschutz bei KI

KI-Systeme verarbeiten personenbezogene Daten in nie dagewesenem Umfang. ADVISORI implementiert Datenschutz by Design für Ihre KI-Projekte: DSGVO-konforme Datenarchitekturen, risikobasierte Datenschutz-Folgenabschaetzungen und EU AI Act-Compliance. Nutzen Sie das Potenzial von KI ohne rechtliche Risiken.

Datenschutz für KI

Setzen Sie Künstliche Intelligenz rechtssicher ein. Unsere KI-Datenschutzexperten implementieren Privacy-by-Design-Architekturen, sichern personenbezogene Daten in AI-Systemen und begleiten Sie durch alle DSGVO-Anforderungen und EU AI Act Pflichten – ohne Kompromisse bei der KI-Performance.

Datensicherheit für KI

Schützen Sie KI-Trainingsdaten, Modelle und Inferenz-Pipelines vor Angriffen und Datenverlust. Unsere Datensicherheitsexperten implementieren technische Schutzmaßnahmen für den gesamten ML-Lebenszyklus — von der Datensammlung über das Training bis zum produktiven Einsatz Ihrer KI-Systeme.

Datenstrategie für KI

Entwickeln Sie eine zukunftssichere Datenstrategie, die Ihre KI-Initiativen zum Erfolg führt. Unsere strategischen Data Governance-Frameworks schaffen die Grundlage für leistungsstarke AI-Systeme und nachhaltigen Geschäftserfolg.

Deployment von KI-Modellen

Bringen Sie Ihre KI-Modelle zuverlässig und skalierbar in die Produktion. Unsere MLOps-Experten implementieren robuste Deployment-Pipelines, automatisieren CI/CD-Prozesse für KI-Modelle und gewährleisten kontinuierliches Monitoring — damit Ihre KI-Systeme performant, DSGVO-konform und EU AI Act-compliant betrieben werden.

EU AI Act Compliance

Seit Februar 2025 gelten die ersten Verbote des EU AI Acts. Stellen Sie sich vor: Montagmorgen, Ihr wichtigster Kunde meldet sich – seine Bank hat gerade eine Warnung der Aufsichtsbehörde erhalten. Grund: Das KI-System für Kreditentscheidungen erfüllt nicht die EU AI Act Anforderungen. Potenzielle Strafe: 35 Millionen Euro oder 7% des Jahresumsatzes. Was als Effizienz-Tool gedacht war, wird zur existenziellen Bedrohung.

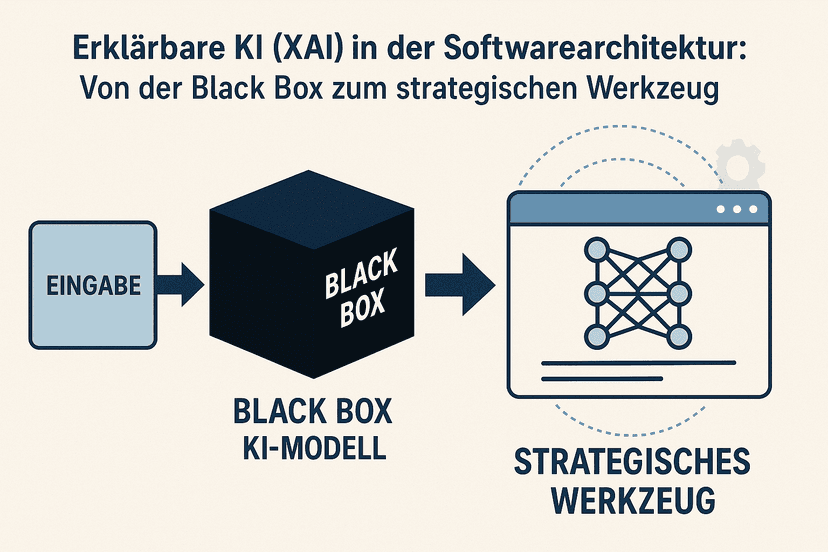

Erklärbare KI

Schaffen Sie Vertrauen und Compliance mit transparenten KI-Systemen. Unsere Explainable AI (XAI) Lösungen machen komplexe Algorithmen nachvollziehbar und ermöglichen fundierte Geschäftsentscheidungen bei gleichzeitiger Erfüllung regulatorischer Anforderungen.

Explainable AI (XAI)

KI-Entscheidungen müssen erkläbar, nachvollziehbar und auditierbar sein – gefordert von DSGVO Art. 22 und EU AI Act. ADVISORI implementiert Explainable-AI-Methoden (SHAP, LIME, Counterfactual Explanations), die Vertrauen schaffen, regulatorische Transparenzpflichten erfüllen und Ihr KI-System audit-ready machen.

KI Computer Vision

Computer Vision ist eine der am schnellsten wachsenden KI-Anwendungen. Wir entwickeln und implementieren DSGVO- und AI-Act-konforme Computer Vision Loesungen für Unternehmen.

Häufig gestellte Fragen zur Gefahren durch KI

Welche konkreten KI-Bedrohungen stellen das größte Risiko für Unternehmen dar und wie identifiziert ADVISORI diese proaktiv?

Die Bedrohungslandschaft für KI-Systeme ist komplex und entwickelt sich kontinuierlich weiter. Für C-Level-Führungskräfte ist es entscheidend zu verstehen, dass KI-Gefahren nicht nur technische Risiken darstellen, sondern fundamentale Geschäftsrisiken, die Reputation, Compliance und Wettbewerbsfähigkeit bedrohen können. ADVISORI verfolgt einen systematischen Ansatz zur Identifikation und Bewertung dieser Bedrohungen, der weit über traditionelle IT-Sicherheit hinausgeht.

🎯 Kritische KI-Bedrohungskategorien:

•

Adversarial Attacks: Gezielte Manipulation von KI-Eingaben zur Täuschung von Modellen, die zu falschen Entscheidungen oder Sicherheitslücken führen können.

•

Data Poisoning: Kontamination von Trainingsdaten mit manipulierten Informationen, die die Modellleistung systematisch beeinträchtigen oder Backdoors schaffen.

•

Model Extraction und IP-Diebstahl: Unbefugte Rekonstruktion proprietärer KI-Modelle durch gezielte Abfragen oder Reverse Engineering.

•

Privacy Leakage: Unbeabsichtigte Preisgabe sensibler Trainingsdaten durch Modellinferenz oder Membership Inference Attacks.

•

Bias Amplification: Verstärkung gesellschaftlicher oder geschäftlicher Vorurteile durch unausgewogene Trainingsdaten oder fehlerhafte Algorithmen.

🔍 ADVISORI's proaktiver Threat Intelligence Ansatz:

•

Kontinuierliche Bedrohungsanalyse: Wir überwachen aktuelle Forschung, Sicherheitsvorfälle und emerging threats in der KI-Sicherheitslandschaft.

Wie können Adversarial Attacks unsere KI-Systeme kompromittieren und welche Schutzmaßnahmen implementiert ADVISORI dagegen?

Adversarial Attacks stellen eine der sophistiziertesten und gefährlichsten Bedrohungen für KI-Systeme dar. Diese gezielten Angriffe nutzen die inhärenten Schwächen von Machine Learning-Modellen aus, um durch minimal veränderte Eingaben drastisch falsche Ausgaben zu erzeugen. Für Unternehmen können solche Angriffe katastrophale Folgen haben, von fehlerhaften Geschäftsentscheidungen bis hin zu Sicherheitsverletzungen. ADVISORI entwickelt mehrschichtige Verteidigungsstrategien, die sowohl präventive als auch reaktive Maßnahmen umfassen.

⚔ ️ Adversarial Attack Mechanismen und Geschäftsrisiken:

•

Evasion Attacks: Manipulation von Eingabedaten zur Laufzeit, um Klassifikationsfehler zu provozieren, beispielsweise bei Betrugserkennungssystemen oder Sicherheitsscannern.

•

Poisoning Attacks: Einschleusung manipulierter Daten während des Trainingsprozesses, um systematische Schwachstellen oder Backdoors zu schaffen.

•

Model Inversion: Rekonstruktion sensibler Trainingsdaten durch gezielte Abfragen, was zu Datenschutzverletzungen führen kann.

•

Membership Inference: Bestimmung, ob spezifische Daten im Trainingssatz enthalten waren, was Rückschlüsse auf vertrauliche Informationen ermöglicht.

🛡 ️ ADVISORI's Multi-Layer Defense Strategy:

•

Adversarial Training: Implementierung robuster Trainingsverfahren, die Modelle gegen bekannte Angriffsmuster immunisieren.

Welche Rolle spielt Data Poisoning bei KI-Angriffen und wie schützt ADVISORI die Integrität unserer Trainingsdaten?

Data Poisoning stellt eine besonders heimtückische Bedrohung dar, da es die Grundlage jedes KI-Systems

•

die Trainingsdaten

•

kompromittiert. Im Gegensatz zu anderen Angriffsformen, die zur Laufzeit stattfinden, erfolgt Data Poisoning bereits während der Modellentwicklung und kann daher schwer zu erkennen sein. Die Auswirkungen können verheerend sein, da kompromittierte Modelle systematisch falsche Entscheidungen treffen oder versteckte Backdoors enthalten können. ADVISORI implementiert umfassende Datenintegritäts- und Validierungsframeworks, die diese Bedrohung von der Datensammlung bis zum Modelldeployment adressieren.

🧬 Data Poisoning Angriffsvektoren und Geschäftsauswirkungen:

•

Label Flipping: Systematische Manipulation von Datenklassifikationen, die zu grundlegend fehlerhaften Modellentscheidungen führen können.

•

Feature Poisoning: Subtile Veränderungen in Eingabemerkmalen, die Modelle für spezifische Trigger-Patterns anfällig machen.

•

Backdoor Injection: Einbettung versteckter Trigger in Trainingsdaten, die später zur Aktivierung unerwünschter Modellverhalten genutzt werden können.

•

Distribution Shift Attacks: Gezielte Verzerrung der Datenverteilung, um Modellleistung in kritischen Bereichen zu degradieren.

🔍 ADVISORI's Comprehensive Data Integrity Framework:

•

Multi-Source Data Validation: Implementierung redundanter Datenquellen und Kreuzvalidierung zur Erkennung von Inkonsistenzen oder Manipulationen.

Wie gewährleistet ADVISORI DSGVO-Compliance bei gleichzeitiger Implementierung effektiver KI-Sicherheitsmaßnahmen?

Die Herausforderung, KI-Sicherheit und DSGVO-Compliance zu vereinen, erfordert einen integrierten Ansatz, der Datenschutz nicht als Hindernis, sondern als fundamentalen Baustein sicherer KI-Systeme betrachtet. ADVISORI entwickelt Privacy-by-Design-Architekturen, die sowohl höchste Sicherheitsstandards als auch vollständige DSGVO-Konformität gewährleisten. Unser Ansatz zeigt, dass Datenschutz und Sicherheit sich gegenseitig verstärken können, anstatt in Konflikt zu stehen.

🔒 Privacy-by-Design für KI-Sicherheit:

•

Differential Privacy Implementation: Einsatz mathematisch beweisbarer Datenschutztechniken, die gleichzeitig vor Membership Inference Attacks und anderen Privacy-Verletzungen schützen.

•

Federated Learning Architectures: Implementierung verteilter Lernverfahren, die Daten lokal belassen und dennoch robuste, sichere Modelle ermöglichen.

•

Homomorphic Encryption: Nutzung verschlüsselter Berechnungen für KI-Inferenz, die sowohl Datenschutz als auch Schutz vor Datenextraktion gewährleisten.

•

Secure Multi-Party Computation: Ermöglichung kollaborativer KI-Entwicklung ohne Preisgabe sensibler Daten zwischen Parteien.

⚖ ️ DSGVO-konforme Sicherheitsgovernance:

•

Data Minimization Strategies: Implementierung von Verfahren, die nur die minimal notwendigen Daten für KI-Training und -Betrieb verwenden.

•

Purpose Limitation Enforcement: Technische Maßnahmen zur Sicherstellung, dass KI-Systeme nur für ihre deklarierten Zwecke verwendet werden können.

Wie können Model Extraction Angriffe unser geistiges Eigentum gefährden und welche Schutzstrategien implementiert ADVISORI?

Model Extraction stellt eine der subtilsten und gleichzeitig gefährlichsten Bedrohungen für Unternehmen dar, die proprietäre KI-Modelle entwickelt haben. Diese Angriffe zielen darauf ab, durch gezielte Abfragen die Funktionalität und das Wissen eines KI-Modells zu rekonstruieren, ohne direkten Zugang zum ursprünglichen Code oder den Trainingsdaten zu haben. Für Unternehmen bedeutet dies den potenziellen Verlust von Millionen-Investitionen in Forschung und Entwicklung sowie strategischen Wettbewerbsvorteilen. ADVISORI entwickelt mehrschichtige Schutzstrategien, die sowohl technische als auch rechtliche Aspekte des IP-Schutzes umfassen.

🔍 Model Extraction Angriffsvektoren und Geschäftsrisiken:

•

Query-based Extraction: Systematische Abfrage von KI-APIs zur Rekonstruktion der Modelllogik und Entscheidungsgrenzen.

•

Membership Inference: Bestimmung, ob spezifische Daten im Trainingssatz enthalten waren, um Rückschlüsse auf proprietäre Datenquellen zu ziehen.

•

Property Inference: Ableitung von Modellarchitektur, Hyperparametern und Trainingsprozessen durch Analyse der Modellresponses.

•

Functional Extraction: Entwicklung von Surrogatmodellen, die ähnliche Funktionalität wie das ursprüngliche Modell bieten.

🛡 ️ ADVISORI's Comprehensive IP Protection Framework:

•

Query Rate Limiting und Behavioral Analysis: Implementierung intelligenter Überwachungssysteme, die verdächtige Abfragemuster erkennen und automatisch Schutzmaßnahmen aktivieren.

Welche spezifischen Risiken entstehen durch Bias und Fairness-Probleme in KI-Systemen und wie adressiert ADVISORI diese ethischen Herausforderungen?

Bias und Fairness-Probleme in KI-Systemen stellen nicht nur ethische Herausforderungen dar, sondern können zu erheblichen rechtlichen, finanziellen und reputativen Risiken für Unternehmen führen. Diskriminierende KI-Entscheidungen können zu Klagen, regulatorischen Sanktionen und dauerhaften Schäden am Markenimage führen. ADVISORI versteht Fairness als fundamentalen Baustein vertrauensvoller KI-Systeme und entwickelt umfassende Frameworks zur Erkennung, Messung und Minimierung von Bias in allen Phasen des KI-Lebenszyklus.

⚖ ️ Bias-Kategorien und Geschäftsrisiken:

•

Historical Bias: Verstärkung gesellschaftlicher Vorurteile durch historische Trainingsdaten, die zu systematischer Diskriminierung führen können.

•

Representation Bias: Unausgewogene Datenrepräsentation bestimmter Gruppen, die zu unfairen Behandlungen führt.

•

Measurement Bias: Systematische Fehler in Datensammlung oder -labeling, die Modellentscheidungen verzerren.

•

Algorithmic Bias: Inhärente Verzerrungen in Algorithmus-Design oder Feature-Selection, die bestimmte Gruppen benachteiligen.

🔍 ADVISORI's Comprehensive Bias Detection Framework:

•

Multi-dimensional Fairness Metrics: Implementierung verschiedener Fairness-Definitionen und Metriken zur umfassenden Bewertung von Modellverhalten.

•

Intersectional Analysis: Untersuchung von Bias-Effekten an der Schnittstelle mehrerer demografischer Merkmale.

•

Counterfactual Fairness Testing: Analyse hypothetischer Szenarien zur Identifikation versteckter Diskriminierungsmuster.

Wie schützt ADVISORI vor Supply Chain Attacks auf KI-Systeme und welche Risiken entstehen durch kompromittierte ML-Bibliotheken?

Supply Chain Attacks auf KI-Systeme stellen eine wachsende und besonders heimtückische Bedrohung dar, da sie die Vertrauenskette zwischen Entwicklern und den von ihnen verwendeten Tools, Bibliotheken und Datenquellen ausnutzen. Diese Angriffe können bereits in frühen Entwicklungsphasen erfolgen und bleiben oft lange unentdeckt, während sie systematisch Schwachstellen oder Backdoors in KI-Systeme einschleusen. ADVISORI entwickelt umfassende Supply Chain Security Frameworks, die jeden Aspekt der KI-Entwicklungskette absichern.

🔗 Supply Chain Angriffsvektoren in der KI-Entwicklung:

•

Compromised ML Libraries: Manipulation populärer Machine Learning-Bibliotheken wie TensorFlow, PyTorch oder scikit-learn durch Einschleusung malicious Code.

•

Poisoned Pre-trained Models: Kontamination öffentlich verfügbarer vortrainierter Modelle mit versteckten Backdoors oder Bias.

•

Malicious Datasets: Bereitstellung manipulierter Trainingsdaten über vermeintlich vertrauenswürdige Quellen.

•

Development Tool Compromise: Angriffe auf Entwicklungsumgebungen, IDEs oder CI/CD-Pipelines zur Manipulation des Build-Prozesses.

🛡 ️ ADVISORI's Multi-Layer Supply Chain Security:

•

Dependency Scanning und Vulnerability Management: Kontinuierliche Überwachung aller verwendeten Bibliotheken und Frameworks auf bekannte Schwachstellen und verdächtige Änderungen.

Welche Rolle spielen Insider Threats bei KI-Sicherheit und wie implementiert ADVISORI Schutzmaßnahmen gegen interne Bedrohungen?

Insider Threats stellen eine der komplexesten und schwer zu erkennenden Bedrohungen für KI-Systeme dar, da sie von Personen ausgehen, die bereits autorisierten Zugang zu kritischen Systemen und Daten haben. Bei KI-Systemen sind die Risiken besonders hoch, da Insider Zugang zu wertvollen Trainingsdaten, proprietären Algorithmen und sensiblen Modellparametern haben können. ADVISORI entwickelt umfassende Insider Threat Detection und Prevention Frameworks, die technische Überwachung mit organisatorischen Maßnahmen kombinieren.

👤 Insider Threat Kategorien in KI-Umgebungen:

•

Malicious Insiders: Mitarbeiter oder Auftragnehmer, die bewusst Schäden verursachen oder geistiges Eigentum stehlen wollen.

•

Compromised Insiders: Legitime Nutzer, deren Accounts oder Geräte von externen Angreifern kompromittiert wurden.

•

Negligent Insiders: Mitarbeiter, die durch Fahrlässigkeit oder mangelndes Sicherheitsbewusstsein Risiken schaffen.

•

Privileged User Abuse: Missbrauch von administrativen oder entwicklungsbezogenen Privilegien für unbefugte Aktivitäten.

🔍 ADVISORI's Behavioral Analytics Framework:

•

User and Entity Behavior Analytics: Kontinuierliche Überwachung von Nutzerverhalten zur Erkennung von Anomalien und verdächtigen Aktivitäten.

•

Data Access Pattern Analysis: Analyse von Datenzugriffsmustern zur Identifikation ungewöhnlicher oder unbefugter Datennutzung.

Welche Risiken entstehen durch KI-Halluzinationen und wie kann ADVISORI diese für kritische Geschäftsentscheidungen minimieren?

KI-Halluzinationen

•

die Generierung falscher oder erfundener Informationen durch KI-Systeme

•

stellen eine der subtilsten und gleichzeitig gefährlichsten Bedrohungen für Unternehmen dar, die KI für kritische Entscheidungen einsetzen. Diese Phänomene können zu fehlerhaften Geschäftsentscheidungen, rechtlichen Problemen und Reputationsschäden führen. ADVISORI entwickelt umfassende Frameworks zur Erkennung, Bewertung und Minimierung von Halluzinationsrisiken in geschäftskritischen KI-Anwendungen.

🧠 Halluzinations-Mechanismen und Geschäftsrisiken:

•

Konfabulation: KI-Systeme generieren plausibel klingende, aber faktisch falsche Informationen, die in Berichten oder Analysen verwendet werden könnten.

•

Source Confusion: Vermischung oder falsche Zuordnung von Informationen aus verschiedenen Quellen, was zu irreführenden Schlussfolgerungen führt.

•

Overconfident Predictions: Übermäßiges Vertrauen in unsichere Vorhersagen, die zu riskanten Geschäftsentscheidungen führen können.

•

Context Drift: Verlust des ursprünglichen Kontexts bei längeren Interaktionen, was zu inkonsistenten oder widersprüchlichen Aussagen führt.

🔍 ADVISORI's Hallucination Detection Framework:

•

Multi-Source Verification: Implementierung von Systemen, die KI-Ausgaben automatisch gegen multiple vertrauenswürdige Quellen validieren.

•

Confidence Scoring und Uncertainty Quantification: Entwicklung von Metriken zur Bewertung der Zuverlässigkeit von KI-Ausgaben.

Wie schützt ADVISORI vor Prompt Injection Angriffen und welche Risiken entstehen durch manipulierte KI-Eingaben?

Prompt Injection Angriffe stellen eine neue Kategorie von Sicherheitsbedrohungen dar, die spezifisch für Large Language Models und generative KI-Systeme entwickelt wurden. Diese Angriffe nutzen die natürlichsprachliche Schnittstelle von KI-Systemen aus, um deren Verhalten zu manipulieren oder unbeabsichtigte Aktionen auszulösen. ADVISORI entwickelt spezialisierte Abwehrstrategien gegen diese emerging threats, die sowohl technische als auch organisatorische Maßnahmen umfassen.

💉 Prompt Injection Angriffsvektoren:

•

Direct Prompt Injection: Direkte Manipulation von Systemprompts durch bösartige Benutzereingaben zur Umgehung von Sicherheitsrichtlinien.

•

Indirect Prompt Injection: Einschleusung manipulativer Anweisungen über externe Datenquellen wie Dokumente oder Webseiten.

•

Jailbreaking: Umgehung von Sicherheitsbeschränkungen durch clevere Formulierungen oder Rollenspiele.

•

Data Exfiltration: Ausnutzung von Prompt Injection zur unbefugten Extraktion sensibler Informationen aus KI-Systemen.

🛡 ️ ADVISORI's Multi-Layer Defense Strategy:

•

Input Sanitization und Validation: Implementierung robuster Filter zur Erkennung und Neutralisierung verdächtiger Eingaben.

•

Prompt Isolation: Trennung von Systemprompts und Benutzereingaben durch technische Barrieren.

•

Context Boundary Enforcement: Strikte Durchsetzung von Kontextgrenzen zur Verhinderung von Prompt Leakage.

Welche spezifischen Risiken entstehen durch KI-Deepfakes und wie implementiert ADVISORI Schutzmaßnahmen gegen synthetische Medien?

Deepfakes und synthetische Medien stellen eine wachsende Bedrohung für Unternehmen dar, da sie für Betrug, Manipulation und Reputationsschäden eingesetzt werden können. Diese Technologien können täuschend echte Audio-, Video- und Bildmaterialien erstellen, die schwer von authentischen Inhalten zu unterscheiden sind. ADVISORI entwickelt umfassende Detection- und Prevention-Strategien zum Schutz vor den vielfältigen Risiken synthetischer Medien.

🎭 Deepfake Bedrohungslandschaft:

•

CEO Fraud und Voice Cloning: Nachahmung von Führungskräften für Betrugsversuche oder unbefugte Anweisungen.

•

Brand Impersonation: Erstellung gefälschter Inhalte zur Schädigung der Unternehmensreputation.

•

Social Engineering: Nutzung synthetischer Medien für sophisticated Phishing und Manipulation.

•

Market Manipulation: Verbreitung falscher Informationen zur Beeinflussung von Aktienkursen oder Geschäftsentscheidungen.

🔍 ADVISORI's Deepfake Detection Framework:

•

Multi-Modal Analysis: Kombination verschiedener Erkennungstechniken für Audio, Video und Bildmaterial.

•

Temporal Inconsistency Detection: Analyse zeitlicher Inkonsistenzen in Videomaterial.

•

Biometric Verification: Überprüfung biometrischer Merkmale zur Authentifizierung von Personen.

•

Blockchain-based Provenance: Implementierung unveränderlicher Herkunftsnachweise für authentische Medien.

🛡 ️ Proactive Protection Measures:

•

Media Authentication Systems: Entwicklung von Systemen zur Verifikation der Authentizität von Medieninhalten.

Wie adressiert ADVISORI die Risiken von KI-Vendor Lock-in und gewährleistet strategische Flexibilität bei KI-Investitionen?

KI-Vendor Lock-in stellt ein erhebliches strategisches Risiko für Unternehmen dar, da es die Flexibilität einschränkt, Kosten erhöht und die Abhängigkeit von einzelnen Anbietern verstärkt. In der schnelllebigen KI-Landschaft kann Lock-in dazu führen, dass Unternehmen nicht von technologischen Fortschritten profitieren können oder bei Problemen mit dem Anbieter handlungsunfähig werden. ADVISORI entwickelt strategische Frameworks zur Vermeidung von Vendor Lock-in und zur Gewährleistung langfristiger Flexibilität.

🔒 Vendor Lock-in Risikokategorien:

•

Technical Lock-in: Abhängigkeit von proprietären APIs, Datenformaten oder Infrastrukturen, die Migration erschweren.

•

Data Lock-in: Schwierigkeiten beim Export oder Transfer von Trainingsdaten und Modellen zwischen Plattformen.

•

Skill Lock-in: Aufbau von Expertise in anbieterspezifischen Tools, die nicht übertragbar sind.

•

Economic Lock-in: Hohe Wechselkosten durch Investitionen in spezifische Technologien oder Verträge.

🏗 ️ ADVISORI's Vendor-Agnostic Architecture Strategy:

•

Multi-Cloud und Hybrid Approaches: Implementierung von Architekturen, die mehrere Cloud-Anbieter und On-Premise-Lösungen kombinieren.

•

Standardized APIs und Interfaces: Verwendung offener Standards und Abstraktionsschichten zur Entkopplung von spezifischen Anbietern.

•

Containerization und Orchestration: Einsatz von Container-Technologien für portable KI-Workloads.

Welche Risiken entstehen durch KI-Modell-Drift und wie implementiert ADVISORI kontinuierliche Überwachung zur Qualitätssicherung?

KI-Modell-Drift stellt eine schleichende aber potenziell verheerende Bedrohung für Unternehmen dar, da sich die Leistung von KI-Systemen über Zeit verschlechtern kann, ohne dass dies sofort erkennbar wird. Diese Degradation kann zu fehlerhaften Geschäftsentscheidungen, Compliance-Verletzungen und Reputationsschäden führen. ADVISORI entwickelt umfassende Monitoring- und Maintenance-Frameworks zur frühzeitigen Erkennung und proaktiven Behandlung von Modell-Drift.

📉 Modell-Drift Kategorien und Geschäftsrisiken:

•

Data Drift: Veränderungen in der Datenverteilung, die dazu führen, dass Modelle auf unbekannten Mustern operieren müssen.

•

Concept Drift: Änderungen in den zugrundeliegenden Beziehungen zwischen Eingabe- und Ausgabevariablen.

•

Performance Drift: Graduelle Verschlechterung der Modellleistung durch verschiedene externe Faktoren.

•

Adversarial Drift: Bewusste Manipulation der Umgebung zur Verschlechterung der Modellleistung.

🔍 ADVISORI's Comprehensive Drift Detection Framework:

•

Statistical Monitoring: Kontinuierliche statistische Analyse von Eingabedaten zur Erkennung von Verteilungsänderungen.

•

Performance Tracking: Überwachung von Modellleistungsmetriken in Echtzeit zur frühzeitigen Erkennung von Degradation.

•

Prediction Confidence Analysis: Analyse der Vorhersagekonfidenzen zur Identifikation unsicherer Modellentscheidungen.

•

Feature Importance Monitoring: Überwachung der Wichtigkeit verschiedener Features zur Erkennung von Konzeptänderungen.

Wie schützt ADVISORI vor KI-basierten Social Engineering Angriffen und welche neuen Bedrohungen entstehen durch intelligente Manipulation?

KI-basierte Social Engineering Angriffe stellen eine neue Generation von Cyber-Bedrohungen dar, die menschliche Psychologie mit fortschrittlicher Technologie kombinieren, um hochgradig personalisierte und überzeugende Angriffe zu erstellen. Diese Bedrohungen können traditionelle Sicherheitsmaßnahmen umgehen, da sie auf menschliche Schwächen abzielen. ADVISORI entwickelt umfassende Abwehrstrategien, die technische Lösungen mit menschenzentrierten Sicherheitsansätzen kombinieren.

🎭 KI-Enhanced Social Engineering Bedrohungen:

•

Hyper-Personalized Phishing: Verwendung von KI zur Erstellung maßgeschneiderter Phishing-Nachrichten basierend auf öffentlich verfügbaren Daten.

•

Voice Cloning Attacks: Nachahmung von Stimmen vertrauenswürdiger Personen für Betrugsversuche oder Manipulation.

•

Behavioral Mimicry: KI-gestützte Nachahmung von Kommunikationsstilen und Verhaltensmustern zur Täuschung.

•

Automated Social Manipulation: Skalierte Manipulation durch KI-gesteuerte Bots und automatisierte Interaktionen.

🛡 ️ ADVISORI's Multi-Dimensional Defense Strategy:

•

AI-Powered Detection: Einsatz von KI-Systemen zur Erkennung ungewöhnlicher Kommunikationsmuster und verdächtiger Inhalte.

•

Behavioral Authentication: Implementierung von Systemen zur Verifikation der Identität basierend auf Verhaltensmustern.

•

Content Analysis: Tiefgreifende Analyse von Nachrichten und Medieninhalten zur Erkennung von Manipulation.

•

Real-time Risk Assessment: Kontinuierliche Bewertung des Risikos eingehender Kommunikation.

Welche spezifischen Risiken entstehen durch KI in kritischen Infrastrukturen und wie implementiert ADVISORI Sicherheitsmaßnahmen für systemkritische Anwendungen?

KI-Systeme in kritischen Infrastrukturen bergen einzigartige Risiken, da Ausfälle oder Kompromittierungen weitreichende gesellschaftliche und wirtschaftliche Folgen haben können. Von Energieversorgung über Verkehrssysteme bis hin zu Finanzinfrastrukturen

•

die Integration von KI in kritische Systeme erfordert höchste Sicherheitsstandards. ADVISORI entwickelt spezialisierte Sicherheitsframeworks für systemkritische KI-Anwendungen.

⚡ Kritische Infrastruktur KI-Risiken:

•

Cascading Failures: KI-Ausfälle, die Kettenreaktionen in vernetzten Infrastruktursystemen auslösen können.

•

Adversarial Attacks on Critical Systems: Gezielte Angriffe auf KI-Systeme zur Störung kritischer Dienste.

•

Safety-Security Convergence: Überschneidung von Sicherheits- und Safety-Risiken in KI-gesteuerten Systemen.

•

Systemic Dependencies: Abhängigkeiten zwischen verschiedenen kritischen Systemen, die durch KI-Ausfälle betroffen sein können.

🏗 ️ ADVISORI's Critical Infrastructure Security Framework:

•

Redundancy und Failover: Implementierung mehrfacher Backup-Systeme und automatischer Failover-Mechanismen.

•

Isolation und Segmentation: Strikte Trennung kritischer KI-Systeme von weniger kritischen Netzwerken.

•

Real-time Monitoring: Kontinuierliche Überwachung aller kritischen KI-Komponenten mit sofortiger Alarmierung.

•

Formal Verification: Mathematische Verifikation kritischer KI-Algorithmen zur Gewährleistung korrekten Verhaltens.

🔒 Advanced Security Measures:

•

Hardware Security Modules: Verwendung spezialisierter Hardware zum Schutz kritischer KI-Operationen.

Wie adressiert ADVISORI die Herausforderungen von KI-Explainability in sicherheitskritischen Anwendungen und gewährleistet Transparenz bei gleichzeitigem Schutz vor Reverse Engineering?

Die Balance zwischen KI-Explainability und Sicherheit stellt eine der komplexesten Herausforderungen in der modernen KI-Entwicklung dar. Während Transparenz für Vertrauen, Compliance und Debugging essentiell ist, kann zu viel Einblick in KI-Systeme Angreifern helfen, Schwachstellen zu identifizieren oder Modelle zu kompromittieren. ADVISORI entwickelt innovative Ansätze für sichere Explainability, die Transparenz ermöglichen, ohne Sicherheit zu gefährden.

🔍 Explainability-Security Dilemma:

•

Information Leakage: Detaillierte Erklärungen können sensible Informationen über Modellarchitektur oder Trainingsdaten preisgeben.

•

Adversarial Exploitation: Angreifer können Erklärungen nutzen, um gezielte Adversarial Attacks zu entwickeln.

•

Model Extraction Risks: Umfassende Erklärungen können bei der unbefugten Rekonstruktion von Modellen helfen.

•

Privacy Violations: Erklärungen können unbeabsichtigt personenbezogene Daten aus Trainingsdaten offenlegen.

🛡 ️ ADVISORI's Secure Explainability Framework:

•

Differential Privacy for Explanations: Implementierung von Differential Privacy Techniken für Erklärungen zur Minimierung von Information Leakage.

•

Layered Explanation Systems: Entwicklung mehrstufiger Erklärungssysteme mit unterschiedlichen Detailgraden je nach Nutzerrolle.

•

Adversarial-Robust Explanations: Erstellung von Erklärungen, die gegen Adversarial Attacks resistent sind.

Welche Risiken entstehen durch KI-Automatisierung in Entscheidungsprozessen und wie gewährleistet ADVISORI menschliche Kontrolle bei kritischen Geschäftsentscheidungen?

Die zunehmende Automatisierung von Entscheidungsprozessen durch KI birgt erhebliche Risiken für Unternehmen, insbesondere wenn kritische Geschäftsentscheidungen ohne angemessene menschliche Aufsicht getroffen werden. Diese Automatisierung kann zu unvorhergesehenen Konsequenzen, rechtlichen Problemen und Vertrauensverlust führen. ADVISORI entwickelt Human-in-the-Loop-Frameworks, die die Effizienz der KI-Automatisierung mit notwendiger menschlicher Kontrolle und Verantwortlichkeit kombinieren.

🤖 Automatisierungs-Risiken in Entscheidungsprozessen:

•

Uncontrolled Decision Cascades: Automatisierte Entscheidungen, die unkontrollierte Kettenreaktionen in Geschäftsprozessen auslösen können.

•

Context Loss: Verlust wichtiger kontextueller Informationen, die nur Menschen verstehen und bewerten können.

•

Accountability Gaps: Unklare Verantwortlichkeiten bei automatisierten Entscheidungen mit negativen Folgen.

•

Ethical Blind Spots: Automatisierte Systeme, die ethische Überlegungen nicht angemessen berücksichtigen können.

🎯 ADVISORI's Human-Centric Automation Framework:

•

Graduated Automation Levels: Implementierung verschiedener Automatisierungsgrade je nach Kritikalität und Risiko der Entscheidung.

•

Human Override Mechanisms: Entwicklung robuster Systeme für menschliche Intervention bei automatisierten Prozessen.

•

Decision Transparency: Vollständige Nachvollziehbarkeit automatisierter Entscheidungen für menschliche Überprüfung.

•

Escalation Protocols: Klare Verfahren für die Eskalation kritischer oder ungewöhnlicher Entscheidungen an menschliche Experten.

Wie adressiert ADVISORI die Herausforderungen von KI-Skalierung und welche Risiken entstehen beim Übergang von Pilotprojekten zu produktiven Systemen?

Der Übergang von erfolgreichen KI-Pilotprojekten zu produktiven, skalierten Systemen stellt eine der größten Herausforderungen für Unternehmen dar. Viele Risiken, die in kleinen Testumgebungen nicht sichtbar sind, können bei der Skalierung zu erheblichen Problemen werden. ADVISORI entwickelt umfassende Skalierungsstrategien, die technische, organisatorische und governance-bezogene Aspekte berücksichtigen, um einen sicheren und erfolgreichen Übergang zu gewährleisten.

📈 Skalierungs-Herausforderungen und Risiken:

•

Performance Degradation: Verschlechterung der Modellleistung bei größeren Datenmengen oder höherer Nutzungsfrequenz.

•

Infrastructure Bottlenecks: Unzureichende technische Infrastruktur für den produktiven Betrieb skalierter KI-Systeme.

•

Data Quality Issues: Qualitätsprobleme, die bei größeren Datenmengen verstärkt auftreten und die Systemleistung beeinträchtigen.

•

Organizational Readiness Gaps: Mangelnde organisatorische Vorbereitung auf den Betrieb produktiver KI-Systeme.

🏗 ️ ADVISORI's Systematic Scaling Framework:

•

Phased Rollout Strategy: Entwicklung strukturierter Phasen für die schrittweise Skalierung von KI-Systemen.

•

Infrastructure Readiness Assessment: Umfassende Bewertung und Vorbereitung der technischen Infrastruktur für Produktionsbetrieb.

•

Performance Benchmarking: Etablierung klarer Leistungsmetriken und Überwachung während der Skalierung.

•

Risk Mitigation Planning: Proaktive Identifikation und Behandlung von Skalierungsrisiken.

Welche spezifischen Risiken entstehen durch KI-Integration in Legacy-Systeme und wie implementiert ADVISORI sichere Modernisierungsstrategien?

Die Integration von KI in bestehende Legacy-Systeme stellt eine besondere Herausforderung dar, da alte Architekturen oft nicht für moderne KI-Anforderungen konzipiert wurden. Diese Integration kann zu Sicherheitslücken, Kompatibilitätsproblemen und unvorhergesehenen Systemausfällen führen. ADVISORI entwickelt spezialisierte Modernisierungsstrategien, die die Vorteile der KI nutzen, ohne die Stabilität und Sicherheit bestehender Systeme zu gefährden.

🏛 ️ Legacy-Integration Herausforderungen:

•

Architectural Mismatch: Inkompatibilität zwischen modernen KI-Architekturen und veralteten Systemdesigns.

•

Security Vulnerabilities: Neue Angriffsvektoren durch die Verbindung von KI-Systemen mit weniger sicheren Legacy-Komponenten.

•

Data Format Incompatibilities: Probleme bei der Datenübertragung zwischen verschiedenen Systemgenerationen.

•

Performance Bottlenecks: Leistungsengpässe durch die Integration schneller KI-Systeme mit langsameren Legacy-Komponenten.

🔧 ADVISORI's Legacy-Safe Integration Strategy:

•

Gradual Modernization Approach: Schrittweise Modernisierung mit minimalen Risiken für bestehende Systeme.

•

API-First Integration: Entwicklung sicherer Schnittstellen für die Kommunikation zwischen KI und Legacy-Systemen.

•

Isolation Layers: Implementierung von Abstraktionsschichten zur Trennung von KI und Legacy-Komponenten.

•

Backward Compatibility: Gewährleistung der Kompatibilität mit bestehenden Systemen und Prozessen.

Wie entwickelt ADVISORI umfassende KI-Incident Response Strategien und welche spezifischen Maßnahmen sind bei KI-Sicherheitsvorfällen erforderlich?

KI-Sicherheitsvorfälle erfordern spezialisierte Incident Response Strategien, die sich von traditionellen Cybersecurity-Vorfällen unterscheiden. Die Komplexität von KI-Systemen, die Schwierigkeit der Ursachenanalyse und die potentiell weitreichenden Auswirkungen erfordern maßgeschneiderte Reaktionsverfahren. ADVISORI entwickelt umfassende KI-Incident Response Frameworks, die schnelle Reaktion, effektive Schadensbegrenzung und systematische Wiederherstellung gewährleisten.

🚨 KI-spezifische Incident Kategorien:

•

Model Compromise: Kompromittierung von KI-Modellen durch Adversarial Attacks oder Data Poisoning.

•

Data Breach in AI Systems: Unbefugter Zugriff auf sensitive Trainingsdaten oder Modellparameter.

•

Algorithmic Bias Incidents: Entdeckung diskriminierender oder unfairer KI-Entscheidungen.

•

Performance Degradation Events: Plötzliche oder graduelle Verschlechterung der KI-Systemleistung.

🎯 ADVISORI's Specialized AI Incident Response Framework:

•

Rapid Detection Systems: Implementierung spezialisierter Monitoring-Systeme für die frühzeitige Erkennung von KI-Vorfällen.

•

AI-Specific Triage Procedures: Entwicklung von Bewertungsverfahren für die Priorisierung verschiedener KI-Incident-Typen.

•

Expert Response Teams: Aufbau spezialisierter Teams mit KI-Expertise für effektive Incident Response.

•

Stakeholder Communication: Klare Kommunikationsstrategien für verschiedene Stakeholder bei KI-Vorfällen.

🔍 Forensic Analysis für KI-Systeme:

•

Model Forensics: Spezialisierte Verfahren zur Analyse kompromittierter oder fehlerhafter KI-Modelle.

Erfolgsgeschichten

Entdecken Sie, wie wir Unternehmen bei ihrer digitalen Transformation unterstützen

Generative KI in der Fertigung

Bosch

KI-Prozessoptimierung für bessere Produktionseffizienz

Fallstudie

Ergebnisse

Reduzierung der Implementierungszeit von AI-Anwendungen auf wenige Wochen

Verbesserung der Produktqualität durch frühzeitige Fehlererkennung

Steigerung der Effizienz in der Fertigung durch reduzierte Downtime

AI Automatisierung in der Produktion

Festo

Intelligente Vernetzung für zukunftsfähige Produktionssysteme

Fallstudie

Ergebnisse

Verbesserung der Produktionsgeschwindigkeit und Flexibilität

Reduzierung der Herstellungskosten durch effizientere Ressourcennutzung

Erhöhung der Kundenzufriedenheit durch personalisierte Produkte

KI-gestützte Fertigungsoptimierung

Siemens

Smarte Fertigungslösungen für maximale Wertschöpfung

Fallstudie

Ergebnisse

Erhebliche Steigerung der Produktionsleistung

Reduzierung von Downtime und Produktionskosten

Verbesserung der Nachhaltigkeit durch effizientere Ressourcennutzung

Digitalisierung im Stahlhandel

Klöckner & Co

Digitalisierung im Stahlhandel

Fallstudie

Ergebnisse

Über 2 Milliarden Euro Umsatz jährlich über digitale Kanäle

Ziel, bis 2022 60% des Umsatzes online zu erzielen

Verbesserung der Kundenzufriedenheit durch automatisierte Prozesse

Lassen Sie uns

Zusammenarbeiten!

Ist Ihr Unternehmen bereit für den nächsten Schritt in die digitale Zukunft? Kontaktieren Sie uns für eine persönliche Beratung.

Ihr strategischer Erfolg beginnt hier

Unsere Kunden vertrauen auf unsere Expertise in digitaler Transformation, Compliance und Risikomanagement

Bereit für den nächsten Schritt?

Vereinbaren Sie jetzt ein strategisches Beratungsgespräch mit unseren Experten

30 Minuten • Unverbindlich • Sofort verfügbar

Zur optimalen Vorbereitung Ihres Strategiegesprächs:

Ihre strategischen Ziele und Herausforderungen

Gewünschte Geschäftsergebnisse und ROI-Erwartungen

Aktuelle Compliance- und Risikosituation

Stakeholder und Entscheidungsträger im Projekt

Bevorzugen Sie direkten Kontakt?

Direkte Hotline für Entscheidungsträger

Strategische Anfragen per E-Mail

Detaillierte Projektanfrage

Für komplexe Anfragen oder wenn Sie spezifische Informationen vorab übermitteln möchten