Datenvolumen beherrschen, Erkenntnisse gewinnen

Big Data Solutions

Große Datenmengen strategisch nutzen: Wir konzipieren und implementieren Big-Data-Plattformen, die strukturierte und unstrukturierte Daten vereinen — von Data Lakes über Echtzeit-Pipelines bis zur KI-Integration. Mit unseren Big-Data-Lösungen bew�ltigen Sie die Herausforderungen exponentiell wachsender Datenvolumen und erschließen deren verborgenes Potenzial.

- ✓Verarbeitung unbegrenzter Datenmengen durch hochskalierbare Architekturen

- ✓Kosteneffizienz durch optimierte Speicher- und Verarbeitungstechnologien (60-80% Einsparung)

- ✓Echte 360-Grad-Sicht auf Kunden und Geschäftsprozesse durch Datenintegration

- ✓Zukunftssichere Datenfundamente für KI, Machine Learning und Advanced Analytics

Ihr Erfolg beginnt hier

Bereit für den nächsten Schritt?

Schnell, einfach und absolut unverbindlich.

Zur optimalen Vorbereitung:

- Ihr Anliegen

- Wunsch-Ergebnis

- Bisherige Schritte

Oder kontaktieren Sie uns direkt:

Zertifikate, Partner und mehr...

Maßgeschneiderte Big-Data-Architekturen für Ihr Unternehmen

Unsere Stärken

- Umfassende Expertise in modernen Big-Data-Technologien und -Plattformen

- Pragmatischer, anwendungsorientierter Implementierungsansatz

- Erfahrenes Team aus Data Engineers, Architekten und Datenspezialisten

- Erfolgreiche Umsetzung komplexer Big-Data-Projekte in verschiedenen Branchen

⚠

Expertentipp

Die größte Herausforderung bei Big-Data-Projekten liegt nicht in der Technologie, sondern in der Definition klarer Anwendungsfälle mit messbarem Geschäftswert. Beginnen Sie mit einem konkreten, hochpriorisierten Use Case und skalieren Sie Ihre Big-Data-Architektur schrittweise. Unternehmen, die diesem fokussierten Ansatz folgen, erreichen eine 3-4x höhere Erfolgsrate und schnellere ROI-Realisierung als bei umfassenden "Big Bang"-Implementierungen.

ADVISORI in Zahlen

11+

Jahre Erfahrung

120+

Mitarbeiter

520+

Projekte

Wir verfolgen einen strukturierten, aber agilen Ansatz bei der Entwicklung und Implementierung von Big-Data-Lösungen. Unsere Methodik stellt sicher, dass Ihre Datenarchitektur sowohl technisch ausgereift als auch geschäftlich wertvoll ist und kontinuierlich an Ihre sich ändernden Anforderungen angepasst werden kann.

Unser Vorgehen

1

Phase 1

Phase 1: Assessment – Analyse Ihrer Datenanforderungen, -quellen und -ziele

2

Phase 2

Phase 2: Architektur – Entwicklung einer maßgeschneiderten Big-Data-Referenzarchitektur

3

Phase 3

Phase 3: Proof of Concept – Validierung der Architektur anhand priorisierter Use Cases

4

Phase 4

Phase 4: Implementation – Schrittweise Umsetzung der Big-Data-Plattform

5

Phase 5

Phase 5: Operationalisierung – Überführung in den produktiven Betrieb und kontinuierliche Optimierung

"Big Data ist weit mehr als nur Technologie – es ist ein strategischer Ansatz, der es Unternehmen ermöglicht, das volle Potenzial ihrer Daten zu erschließen. Der Schlüssel zum Erfolg liegt dabei nicht in der Menge der verarbeiteten Daten, sondern in der Fähigkeit, aus diesen Daten relevante Erkenntnisse zu gewinnen und diese in konkrete Geschäftswerte zu überführen."

Asan Stefanski

Head of Digital Transformation

Expertise & Erfahrung:

11+ Jahre Erfahrung, Studium Angewandte Informatik, Strategische Planung und Leitung von KI-Projekten, Cyber Security, Secure Software Development, AI

Unsere Dienstleistungen

Wir bieten Ihnen maßgeschneiderte Lösungen für Ihre digitale Transformation

Skalierbare Data Lake Architekturen

Konzeption und Implementierung moderner Data Lakes für die kosteneffiziente Speicherung und Verarbeitung großer Mengen strukturierter und unstrukturierter Daten.

- Konzeption und Implementierung von Cloud-basierten oder On-Premise Data Lakes

- Integration heterogener Datenquellen und -formate

- Aufbau von Data Lake Governance und Sicherheitskonzepten

- Entwicklung von Data Cataloging und Metadatenmanagement

Moderne Data Warehousing Lösungen

Entwicklung moderner, skalierbarer Data-Warehouse-Architekturen für Business Intelligence, Reporting und fortschrittliche Analysen.

- Implementierung cloud-nativer Data Warehouses

- Konzeption von Data Marts für spezifische Geschäftsbereiche

- Entwicklung von semantischen Schichten für Self-Service BI

- Performance-Optimierung für komplexe analytische Abfragen

Data Engineering & Processing Pipelines

Entwicklung effizienter Datenpipelines für die Extraktion, Transformation, Anreicherung und Bereitstellung von Daten in Batch- und Echtzeit-Prozessen.

- Implementierung von ETL/ELT-Prozessen mit modernen Frameworks

- Entwicklung von Stream-Processing-Pipelines für Echtzeit-Daten

- Aufbau datengetriebener Workflows mit Orchestrierungstools

- Qualitätssicherung und Monitoring von Datenpipelines

Data Governance & Compliance

Entwicklung und Implementierung von Governance-Frameworks für Big-Data-Umgebungen, die Datenqualität, Sicherheit und Compliance sicherstellen.

- Entwicklung von Data-Governance-Frameworks und -Prozessen

- Implementierung von Datenschutz- und Compliance-Mechanismen

- Aufbau von Datenqualitätsmanagement und Monitoring

- Entwicklung von Data Lineage und Audit-Trails

Unsere Kompetenzen im Bereich Advanced Analytics

Wählen Sie den passenden Bereich für Ihre Anforderungen

Machine Learning

Transformieren Sie Ihre Daten in intelligente Systeme, die kontinuierlich lernen und sich verbessern. Mit unseren Machine-Learning-Lösungen entwickeln Sie lernfähige Algorithmen, die Muster in Ihren Daten erkennen, Vorhersagen treffen und komplexe Entscheidungen automatisieren. ADVISORI unterstützt Sie bei der Konzeption, Entwicklung und Implementierung maßgeschneiderter ML-Anwendungen, die messbare Geschäftswerte schaffen.

Predictive Analytics

Transformieren Sie Ihre historischen Daten in präzise Vorhersagen über zukünftige Entwicklungen und Trends. Mit unseren Predictive-Analytics-Lösungen erschließen Sie verborgene Zusammenhänge in Ihren Daten und treffen proaktive Entscheidungen mit höchster Treffsicherheit. Wir unterstützen Sie bei der Entwicklung und Implementierung maßgeschneiderter Prognosemodelle, die Ihre spezifischen Geschäftsanforderungen optimal abbilden.

Prescriptive Analytics

Transformieren Sie Prognosen in konkrete Handlungen und optimale Entscheidungen. Mit unseren Prescriptive-Analytics-Lösungen gehen Sie über das "Was wird passieren?" hinaus und beantworten die Frage "Was sollten wir tun?". Wir unterstützen Sie bei der Entwicklung intelligenter Systeme, die nicht nur Zukunftsprognosen liefern, sondern auch optimale Handlungsalternativen identifizieren und komplexe Entscheidungsprozesse teilweise oder vollständig automatisieren.

Real-time Analytics

Transformieren Sie kontinuierliche Datenströme in sofortige Erkenntnisse und Handlungen. Mit unseren Real-time-Analytics-Lösungen analysieren Sie Daten im Moment ihrer Entstehung, erkennen kritische Ereignisse unmittelbar und reagieren proaktiv auf sich ändernde Bedingungen. Wir unterstützen Sie bei der Implementierung leistungsfähiger Echtzeit-Analysesysteme, die Ihre Reaktionsfähigkeit revolutionieren und Ihnen entscheidende Wettbewerbsvorteile verschaffen.

Häufig gestellte Fragen zur Big Data Solutions

Was ist eine Big Data Lösung und wann braucht ein Unternehmen sie?

Eine Big Data Lösung ist eine Kombination aus Technologien, Architekturen und Prozessen, die große, heterogene Datenmengen speichern, verarbeiten und analysieren. Unternehmen benütigen sie, wenn klassische Datenbanken an Skalierungsgrenzen stoßen — typisch ab Datenvolumen im Terabyte-Bereich, bei Echtzeit-Anforderungen oder wenn strukturierte und unstrukturierte Daten aus vielen Quellen zusammengeführt werden müssen. Konkrete Indikatoren sind langsame Abfragen, isolierte Datensilos und fehlende Grundlagen für KI- oder Analytics-Projekte.

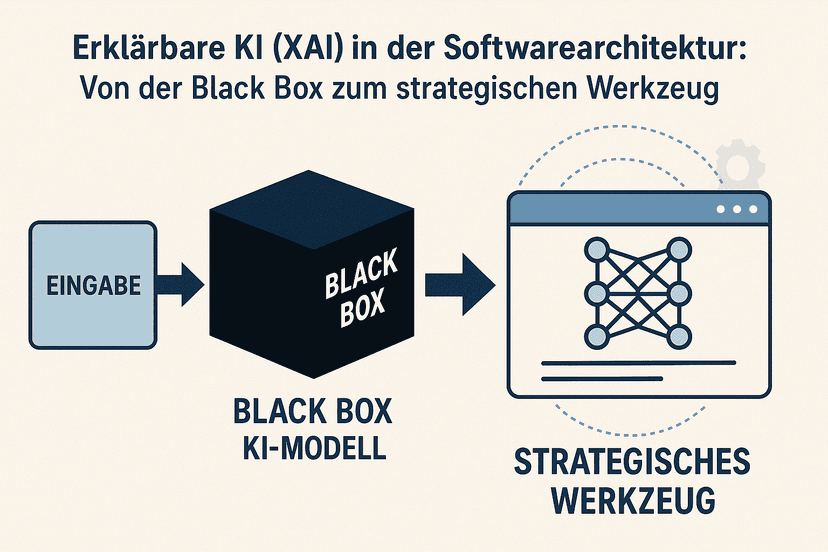

Wie ist eine moderne Big Data Architektur aufgebaut?

Moderne Big Data Architekturen folgen einem Schichtenmodell: Die Ingestionsschicht nimmt Daten aus Quellsystemen per Batch oder Streaming auf. Die Speicherschicht nutzt Data Lakes für Rohdaten und Data Warehouses für kuratierte Daten — zunehmend als Lakehouse kombiniert. Die Verarbeitungsschicht transformiert Daten mit Engines wie Apache Spark oder Flink. Die Analyseschicht stellt aufbereitete Daten für BI, Machine Learning und Reporting bereit. Quer dazu liegen Data Governance, Sicherheit und Metadatenmanagement. Aktuelle Architekturmuster sind Data Mesh für dezentrale Verantwortung und Data Fabric für automatisierte Integration.

Welche Technologien werden bei Big Data Projekten eingesetzt?

Die Technologiewahl hängt vom konkreten Anwendungsfall ab. Für Speicherung kommen Cloud-native Lösungen wie AWS S3, Azure Data Lake Storage oder Google BigQuery zum Einsatz. Apache Spark dominiert die Batch-Verarbeitung, Apache Kafka und Flink die Echtzeit-Verarbeitung. Für Data Warehousing setzen viele Unternehmen auf Snowflake, Databricks oder Synapse Analytics. Open-Table-Formate wie Delta Lake und Apache Iceberg ermüglichen Lakehouse-Architekturen. Bei Data Governance und Katalogisierung haben sich Apache Atlas, Alation und Collibra etabliert. ADVISORI w�hlt Technologien anhand Ihrer bestehenden Infrastruktur und Anforderungen aus.

Wie lange dauert die Implementierung einer Big Data Plattform?

Ein erster produktiver Proof of Concept mit einem konkreten Use Case ist in acht bis zwölf Wochen realisierbar. Der Aufbau einer vollständigen, unternehmensweiten Big Data Plattform dauert typisch sechs bis zwölf Monate, abhängig von der Anzahl der Datenquellen, Integrationsanforderungen und dem gew�nschten Reifegrad. ADVISORI empfiehlt einen iterativen Ansatz: Mit einem priorisierten Anwendungsfall starten, die Architektur validieren und dann schrittweise skalieren. Unternehmen, die diesem fokussierten Vorgehen folgen, erreichen eine drei- bis vierfach höhere Erfolgsrate als bei umfassenden Einmalimplementierungen.

Was kostet Big Data Beratung und welchen ROI kann man erwarten?

Die Kosten für Big Data Beratung variieren je nach Umfang: Eine Strategieentwicklung mit Architekturkonzept liegt typisch im fünfstelligen Bereich, eine vollständige Plattformimplementierung im sechs- bis siebenstelligen Bereich. Der ROI zeigt sich in mehreren Dimensionen:

60 bis

80 Prozent Einsparung bei Speicher- und Verarbeitungskosten durch optimierte Technologiewahl, schnellere Entscheidungsfindung durch Echtzeit-Analysen und neue Umsatzpotenziale durch datengetriebene Geschäftsmodelle. Entscheidend für den ROI ist die Definition konkreter Anwendungsf�lle mit messbarem Geschäftswert vor Projektbeginn.

Wie stellt man Datensicherheit und DSGVO-Konformität bei Big Data sicher?

Datensicherheit beginnt bei der Architektur: Verschlässelung im Ruhezustand und bei der übertragung, rollenbasierte Zugriffssteuerung und Netzwerksegmentierung bilden die Grundlage. Für DSGVO-Konformität sind Datenmaskierung, Pseudonymisierung und klare Läschkonzepte erforderlich. Data Lineage dokumentiert, woher Daten stammen und wie sie verarbeitet werden — ein zentraler Nachweis für Auditierbarkeit. Ein Data-Governance-Framework definiert Verantwortlichkeiten, Klassifizierung und Zugriffsrichtlinien. ADVISORI integriert Sicherheit und Compliance von Beginn an in die Architektur, statt sie nachträglich aufzusetzen.

Wie integriert man Big Data in bestehende IT-Systeme?

Die Integration erfolgt über vier Ansätze, abhängig von der Ausgangslage: Parallelinstallation, bei der die Big Data Plattform neben bestehenden Systemen läuft und über APIs verbunden wird. Hybridansatz mit schrittweiser Migration einzelner Workloads. Change Data Capture für die Echtzeit-Synchronisation zwischen Legacy-Systemen und der neuen Plattform. Data Virtualization für eine einheitliche Sicht ohne physische Datenbewegung. Entscheidend ist ein klarer Integrationsplan, der Datenflässe, Abhängigkeiten und Migrationsprioritäten definiert. ADVISORI hat in über

520 Projekten Erfahrung mit der Integration in heterogene Unternehmenslandschaften.

Erfolgsgeschichten

Entdecken Sie, wie wir Unternehmen bei ihrer digitalen Transformation unterstützen

Generative KI in der Fertigung

Bosch

KI-Prozessoptimierung für bessere Produktionseffizienz

Fallstudie

Ergebnisse

Reduzierung der Implementierungszeit von AI-Anwendungen auf wenige Wochen

Verbesserung der Produktqualität durch frühzeitige Fehlererkennung

Steigerung der Effizienz in der Fertigung durch reduzierte Downtime

AI Automatisierung in der Produktion

Festo

Intelligente Vernetzung für zukunftsfähige Produktionssysteme

Fallstudie

Ergebnisse

Verbesserung der Produktionsgeschwindigkeit und Flexibilität

Reduzierung der Herstellungskosten durch effizientere Ressourcennutzung

Erhöhung der Kundenzufriedenheit durch personalisierte Produkte

KI-gestützte Fertigungsoptimierung

Siemens

Smarte Fertigungslösungen für maximale Wertschöpfung

Fallstudie

Ergebnisse

Erhebliche Steigerung der Produktionsleistung

Reduzierung von Downtime und Produktionskosten

Verbesserung der Nachhaltigkeit durch effizientere Ressourcennutzung

Digitalisierung im Stahlhandel

Klöckner & Co

Digitalisierung im Stahlhandel

Fallstudie

Ergebnisse

Über 2 Milliarden Euro Umsatz jährlich über digitale Kanäle

Ziel, bis 2022 60% des Umsatzes online zu erzielen

Verbesserung der Kundenzufriedenheit durch automatisierte Prozesse

Lassen Sie uns

Zusammenarbeiten!

Ist Ihr Unternehmen bereit für den nächsten Schritt in die digitale Zukunft? Kontaktieren Sie uns für eine persönliche Beratung.

Ihr strategischer Erfolg beginnt hier

Unsere Kunden vertrauen auf unsere Expertise in digitaler Transformation, Compliance und Risikomanagement

Bereit für den nächsten Schritt?

Vereinbaren Sie jetzt ein strategisches Beratungsgespräch mit unseren Experten

30 Minuten • Unverbindlich • Sofort verfügbar

Zur optimalen Vorbereitung Ihres Strategiegesprächs:

Ihre strategischen Ziele und Herausforderungen

Gewünschte Geschäftsergebnisse und ROI-Erwartungen

Aktuelle Compliance- und Risikosituation

Stakeholder und Entscheidungsträger im Projekt

Bevorzugen Sie direkten Kontakt?

Direkte Hotline für Entscheidungsträger

Strategische Anfragen per E-Mail

Detaillierte Projektanfrage

Für komplexe Anfragen oder wenn Sie spezifische Informationen vorab übermitteln möchten